Quer insights mais inteligentes em sua caixa de entrada? Inscreva -se para que nossos boletins semanais obtenham apenas o que importa para a IA, dados e líderes de segurança corporativos. Inscreva -se agora

Uma nova estrutura de treinamento desenvolvido por pesquisadores em TENCENT AI LAB e Universidade de Washington em St. Louis permite que grandes modelos de linguagem (LLMs) melhorem a si mesmos sem exigir quaisquer dados marcados com humanos. A técnica, chamada R-zeroUtiliza o aprendizado de reforço para gerar seus próprios dados de treinamento do zero, abordando um dos principais gargalos na criação de sistemas de IA em evolução. O R-Zero trabalha com dois modelos independentes co-evoluindo, interagindo e desafiando um ao outro.

As experiências mostram que o R-Zero melhora substancialmente as capacidades de raciocínio em diferentes LLMs, o que pode diminuir a complexidade e os custos do treinamento de IA avançada. Para as empresas, essa abordagem pode acelerar o desenvolvimento de modelos especializados para tarefas complexas de raciocínio sem a grande despesa de curadoria de conjuntos de dados rotulados.

O desafio de LLMs auto-evoluir

A idéia por trás do LLMS de evolução é criar sistemas de IA que possam gerar, refinar e aprender de maneira autônoma. Isso oferece um caminho escalável para a IA mais inteligente e capaz. No entanto, um grande desafio é que o treinamento desses modelos requer grandes volumes de tarefas e etiquetas de alta qualidade, que atuam como sinais de supervisão para a IA aprender.

Confiar nos anotadores humanos para criar esses dados não é apenas caro e lento, mas também cria um gargalo basic. Ele efetivamente limita as capacidades potenciais de uma IA ao que os humanos podem ensiná -lo. Para abordar isso, os pesquisadores desenvolveram métodos sem rótulos que derivam sinais de recompensa diretamente das próprias saídas de um modelo, por exemplo, medindo sua confiança em uma resposta. Embora esses métodos eliminem a necessidade de rótulos explícitos, eles ainda dependem de um conjunto de tarefas pré-existentes, limitando assim sua aplicabilidade em cenários verdadeiramente evolutivos.

Ai escala atinge seus limites

Capitões de energia, custos crescentes de token e atrasos de inferência estão remodelando a IA corporativa. Junte -se ao nosso salão exclusivo para descobrir como são as principais equipes:

- Transformando energia em uma vantagem estratégica

- Arquitetagem Inferência eficiente para ganhos reais de rendimento

- Desbloqueando o ROI competitivo com sistemas de IA sustentáveis

Prenda seu lugar para ficar à frente:

Outras abordagens envolvem que os modelos gerem suas próprias tarefas para aprender. No entanto, em domínios como o raciocínio aberto, onde não há maneira simples de verificar a correção (como um executor de código), garantir que a qualidade desses dados auto-gerados seja um obstáculo significativo.

Como funciona o R-Zero

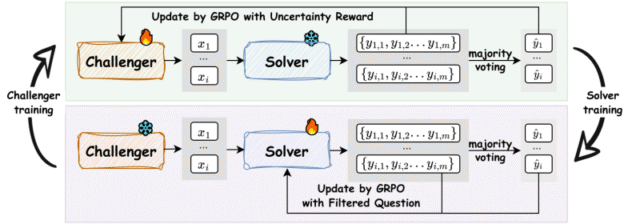

O R-Zero é uma estrutura projetada para treinar LLMs de Rachoining que pode evoluir a partir de dados externos zero. O processo começa com um modelo de base única, que é dividida em dois papéis: um “desafiante” e um “solucionador”. Esses dois modelos são otimizados de forma independente, mas evoluem juntos através de um ciclo contínuo de interação.

O objetivo do Challenger é criar novas tarefas que estão no limiar das habilidades atuais do solucionador, nem muito fáceis nem impossíveis. O solucionador, por sua vez, é recompensado por resolver essas tarefas cada vez mais complexas. Em comentários escritos a VentureBeat, Chengsong Huang, co-autor do artigo e estudante de doutorado na Universidade de Washington em St. Louis, explicou que essa dinâmica é essential porque gerar perguntas de alta qualidade geralmente é mais complicado do que encontrar as respostas.

“O que descobrimos em um cenário prático é que o maior desafio não é gerar as respostas … mas gerar perguntas de alta qualidade, romance e progressivamente mais difíceis”, disse Huang. “Acreditamos que bons professores são muito mais raros que os bons alunos. A dinâmica co-evolutiva automatiza a criação desse ‘professor’, garantindo um currículo constante e dinâmico que impulsiona as capacidades do solucionador muito além do que um conjunto de dados estático e pré-existente poderia alcançar”.

Depois que o Challenger gera perguntas suficientes, eles são filtrados para diversidade e compilados em um conjunto de dados de treinamento. Na fase de treinamento do solucionador, ele é ajustado sobre essas questões desafiadoras. A resposta “correta” para cada pergunta é determinada por um voto majoritário das próprias tentativas anteriores do solucionador.

Todo esse processo se repete, criando um loop auto-improvável que opera sem nenhuma intervenção humana, permitindo que os dois modelos se esforcem para se tornar progressivamente mais capaz em cada iteração.

R-zero em ação

Os pesquisadores testaram o R-Zero em vários LLMs de código aberto, incluindo modelos das famílias QWEN3 e Octothinker. Eles primeiro treinaram os modelos sobre problemas matemáticos e depois testaram se as habilidades de raciocínio aprendidas poderiam generalizar para outros referências complexas e de domínio geral como Mmlu-pro (compreensão e raciocínio de vários idiomas) e Supergpqa (Tarefas de ciência e raciocínio).

Os resultados mostraram que o R-zero é uma estrutura altamente eficaz e agnóstica do modelo. Por exemplo, aumentou a pontuação do modelo QWEN3-4B-BASE em +6,49, em média, nos benchmarks de raciocínio matemático. O processo de treinamento melhorou de forma consistente e substancial, com ganhos se acumulando com várias iterações. O modelo maior de QWEN3-8B-BASE viu sua pontuação matemática média subir em +5,51 pontos após três iterações.

Uma descoberta importante foi o desempenho imediato do desempenho após a primeira iteração, que validou a eficácia do papel do desafiante na criação de um currículo de aprendizado de alta qualidade. “Isso confirma que o currículo inteligente gerado pelo desafiante treinado pela RL é significativamente mais eficaz do que o de um gerador não treinado”, escrevem os pesquisadores em seu artigo.

Notavelmente, as habilidades aprendidas com os problemas matemáticas foram efetivamente transferidas para tarefas gerais de raciocínio, aumentando assim as capacidades subjacentes dos modelos. Por exemplo, o mesmo modelo QWEN3-4B-BASE mostrou uma melhoria de +7,54 em benchmarks de raciocínio do domínio geral. Outra descoberta interessante é que o R-Zero pode servir como uma etapa decisiva de pré-treinamento. Os modelos melhoraram pela primeira vez pelo R-Zero alcançaram um desempenho ainda maior quando posteriormente ajustados nos dados tradicionais rotulados, sugerindo que a estrutura atua como um amplificador de desempenho.

Para as empresas, a abordagem “From Zero Knowledge” pode ser um divisor de águas, especialmente em domínios de nicho, onde dados de alta qualidade são escassos ou inexistentes. Huang destaca que a principal vantagem da R-Zero é sua capacidade de evitar a parte mais cara e demorada do desenvolvimento da IA: Curadoria de Dados.

“Nossa abordagem ignora inteiramente o gargalo basic de ter que encontrar, rotular e curar conjuntos de dados de alta qualidade”, disse ele. “Não se trata apenas de uma medida de economia de custos; é um caminho para a criação de IA que pode superar as capacidades humanas, porque não é mais limitada pelo escopo do conhecimento ou dados humanos”.

No entanto, o processo co-evolutivo também revelou um desafio crítico. À medida que o desafiante gera com sucesso problemas progressivamente mais difíceis, a capacidade do solucionador de produzir respostas “corretas” confiáveis por meio da maioria dos votos começa a diminuir. Os pesquisadores descobriram que a verdadeira precisão desses rótulos auto-gerados caiu de 79% na primeira iteração para 63% pelo terceirocomparado a um forte Oracle LLM, como GPT -4. Esse declínio na qualidade dos dados é uma troca-chave e um gargalo em potencial para o desempenho a longo prazo do sistema.

Huang reconheceu que esse é um problema basic para o paradigma de evolução. “Nosso trabalho é uma prova de conceito que demonstra o potencial dessa abordagem, mas reconhecemos que manter a melhoria estável e a longo prazo sem platôs é um obstáculo significativo”, disse ele. “Resolver esse problema será um próximo passo essential para toda a comunidade de pesquisa”.

Os pesquisadores também destacam uma limitação basic da estrutura: o mecanismo atual é mais adequado para domínios como matemática, onde a correção pode ser determinada objetivamente. Então, como esse poderoso paradigma poderia ser estendido a tarefas corporativas mais subjetivas, como gerar cópias de advertising and marketing ou resumir relatórios?

Huang sugere que um caminho potencial envolve a adição de um terceiro agente de IA em evolução à mistura: um “verificador” ou “crítico”.

“Em vez de avaliar uma resposta simples ‘correta’, esse verificador seria treinado para avaliar a qualidade da saída do solucionador com base em critérios mais sutis”, explicou ele. “A dinâmica co-evolutiva envolveria o desafiante a criação do immediate, o solucionador gerando a resposta e o verificador fornecendo um sinal de qualidade, com os três modelos melhorando juntos”.

Embora isso proceed sendo uma direção para pesquisas futuras, aponta para um futuro em que os sistemas de IA totalmente autônomos podem dominar não apenas a lógica objetiva, mas também o raciocínio subjetivo.

avots